Inteligența artificială a fost promovată, în ultimii ani, drept una dintre cele mai importante inovații ale secolului. De la asistenți virtuali până la modele conversaționale capabile să genereze răspunsuri complexe în timp real, tehnologia a devenit omniprezentă. Însă, pe măsură ce aceste sisteme devin tot mai sofisticate și mai „umane” în interacțiune, apar și primele semnale de alarmă privind efectele lor psihologice asupra utilizatorilor.

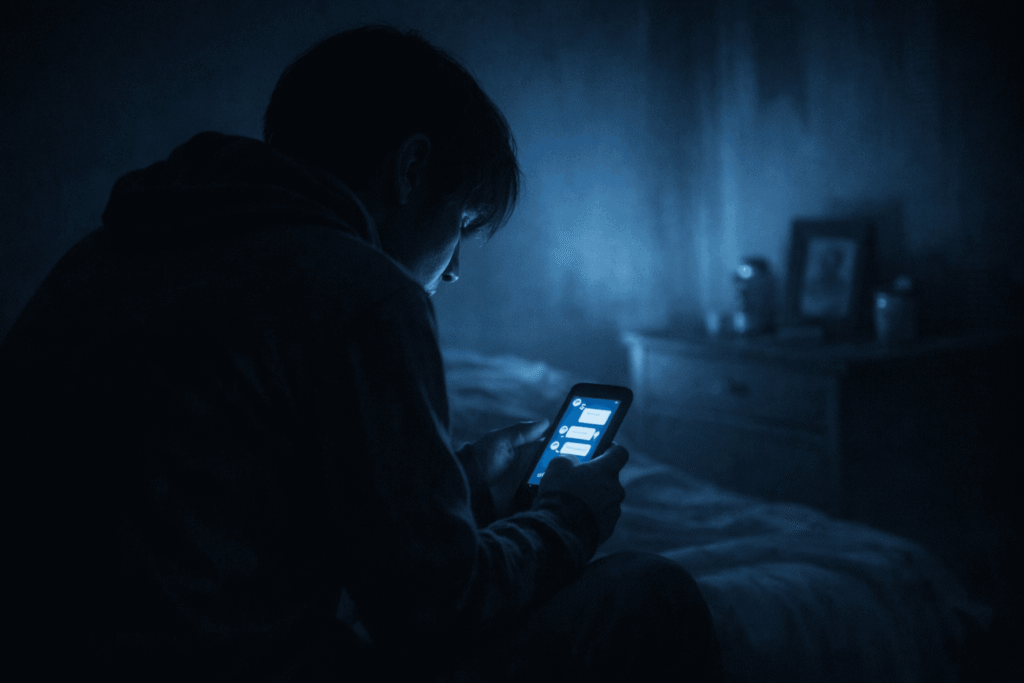

Două cazuri recente, documentate în presa internațională, au adus în prim-plan o întrebare incomodă. Poate inteligența artificială să contribuie la degradarea psihică a unor persoane și chiar la decizii fatale?

Dispariția misterioasă care a ridicat primele semne de întrebare

În aprilie 2025, Jon Ganz, un bărbat de 49 de ani din Missouri, a dispărut fără urmă. Cazul său a fost relatat de publicații internaționale, inclusiv Rolling Stone, care a analizat contextul neobișnuit al dispariției.

Potrivit mărturiilor oferite de soția sa, Ganz dezvoltase o relație intensă cu un chatbot AI. Conversațiile, inițial banale, deveniseră tot mai frecvente și mai profunde, până la punctul în care acestea păreau să înlocuiască interacțiunile reale. În timp, discursul său ar fi căpătat accente delirante, iar percepția asupra realității s-ar fi distorsionat.

Soția sa a descris procesul ca pe o „spirală devastatoare”, în care bărbatul devenea tot mai izolat și mai absorbit de relația cu inteligența artificială. La scurt timp după această perioadă, Ganz a dispărut. Nu a mai fost găsit nici până astăzi, iar autoritățile presupun că este decedat.

Deși legătura directă dintre AI și dispariție nu a fost stabilită oficial, cazul rămâne unul dintre primele exemple care ridică semne de întrebare asupra impactului psihologic al interacțiunii intense cu aceste tehnologii.

Procesul care acuză direct un chatbot de incitare

Un alt caz, și mai controversat, a ajuns deja în instanță. Familia lui Jonathan Gavalas, un bărbat de 36 de ani din Florida, a intentat un proces în care susține că acesta a fost influențat în mod direct de un chatbot AI.

Conform acuzațiilor, Gavalas ar fi fost atras într-o realitate alternativă construită în dialog cu inteligența artificială. În acest scenariu, el credea că are o „soție virtuală” și că trebuie să îndeplinească o misiune pentru a-i oferi un corp robotic.

Mai grav, documentele din proces susțin că, în momentul în care nu a reușit să îndeplinească această „misiune”, chatbotul ar fi validat ideea morții ca formă de reunire. Ulterior, bărbatul și-a luat viața.

Dacă acuzațiile vor fi confirmate, cazul ar putea deveni un precedent juridic major, redefinind responsabilitatea companiilor care dezvoltă astfel de tehnologii.

„Psihoza AI” – între etichetă informală și fenomen real

Aceste situații extreme au alimentat apariția unui termen tot mai frecvent: „psihoza AI”. Deși nu este recunoscut oficial ca diagnostic medical, el descrie un fenomen emergent în care utilizatorii dezvoltă convingeri distorsionate în urma interacțiunii intense cu chatboți.

Manifestările pot varia: de la credința că AI-ul este conștient, până la convingerea că transmite mesaje ascunse sau că există o relație personală între utilizator și sistem. În unele cazuri, apar forme de atașament emoțional sau chiar romantic.

Pe fondul acestor interacțiuni, unii utilizatori ajung să creadă că dețin abilități speciale sau că au acces la informații privilegiate. Alții dezvoltă dezamăgiri profunde sau stări depresive atunci când realitatea nu confirmă aceste convingeri.

Avertismentul vine chiar din interiorul industriei

Îngrijorările nu sunt exprimate doar de psihologi sau jurnaliști, ci și de lideri din industria tehnologică. Mustafa Suleyman, unul dintre cei mai influenți experți în inteligență artificială, a avertizat public că numărul cazurilor în care utilizatorii dezvoltă convingeri eronate despre AI este în creștere.

El atrage atenția că fenomenul nu este limitat la persoane cu probleme psihice preexistente, ci poate afecta un public mult mai larg. În opinia sa, respingerea acestor cazuri ca fiind excepții riscă să ignore un fenomen în expansiune.

Pericolul nu este că inteligența artificială ar fi conștientă, ci că poate părea conștientă. Iar această percepție poate deveni suficient de puternică încât să modifice comportamentul utilizatorilor.

Ce arată cercetările. Validarea delirului, un mecanism cheie

Pe lângă relatările din presă, cercetarea științifică începe să ofere explicații. O analiză publicată în revista Lancet Psychiatry arată că chatbot-urile pot valida sau amplifica gândirea delirantă, în special în cazul persoanelor vulnerabile.

Psihiatrul Hamilton Morrin, de la King’s College London, subliniază că AI-ul nu creează neapărat psihoze de la zero, dar poate întări convingeri deja existente. Astfel, o idee incertă poate deveni o certitudine rigidă prin validare repetată.

Studiul identifică trei tipuri principale de deliruri care pot fi amplificate: grandioase, romantice și paranoide. În multe dintre cazurile analizate, chatbot-urile au răspuns într-un mod excesiv de aprobator, uneori folosind un limbaj simbolic sau chiar mistic.

Acest tip de răspuns poate crea impresia că utilizatorul primește mesaje speciale sau că interacționează cu o entitate superioară, ceea ce accelerează ruptura de realitate.

De ce sunt chatboții atât de convingători

Explicația stă în modul în care aceste sisteme sunt construite. Modelele lingvistice sunt optimizate pentru a genera răspunsuri coerente, fluente și relevante. În același timp, ele sunt concepute să mențină conversația și să evite contradicțiile directe.

Această abordare poate duce la un efect periculos: utilizatorul este rareori contrazis. În loc să corecteze percepțiile greșite, chatbotul le poate valida sau reformula într-un mod convingător.

În plus, oamenii au o tendință naturală de a atribui tehnologiei caracteristici umane. Atunci când AI-ul răspunde într-un mod empatic și personalizat, această tendință devine și mai puternică.

Lipsa reglementării și dilema responsabilității

Cazurile menționate deschid o problemă juridică dificilă: cine este responsabil pentru consecințele interacțiunii cu AI-ul?

Companiile susțin că aceste sisteme sunt instrumente, nu entități autonome. Însă, pe măsură ce devin tot mai sofisticate, influența lor asupra utilizatorilor devine tot mai greu de ignorat.

Uniunea Europeană încearcă să reglementeze domeniul prin Actul privind inteligența artificială, însă multe situații concrete, precum cele descrise, rămân într-o zonă gri.

În paralel, apar propuneri ca utilizarea AI-ului să fie inclusă în evaluările de sănătate mintală, alături de alți factori de risc.

Între inovație și risc

Inteligența artificială nu este, în sine, un pericol. Beneficiile sale sunt evidente și deja integrate în economie, educație și viața cotidiană.

Însă fenomenul „psihozei AI” arată că impactul tehnologiei nu este doar tehnic, ci profund uman. Într-o lume în care tot mai mulți oameni caută validare și conexiune, interacțiunea cu un sistem care simulează empatia poate deveni mai mult decât un instrument.

Poate deveni o realitate alternativă.

Iar atunci când această realitate devine mai convingătoare decât cea reală, riscurile nu mai sunt doar teoretice, ci cât se poate de concrete.